Profundidad simplicial coloreada (¡finalmente resuelto!)

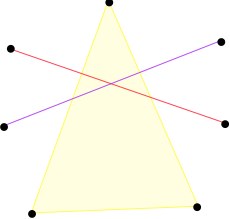

Un resultado clásico de Bárány en geometría discreta dice lo siguiente (donde se refiere a la envolvente convex de

)

Teorema (Carathéodory coloreado, Bárány 1982).

Dados conjuntos

en

y un punto

tal que

para cada

, existen puntos

de tal forma que

.

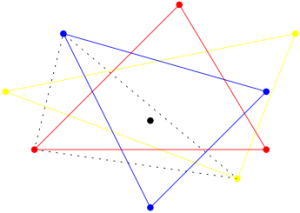

Por ejemplo, en el plano, si hay 3 triángulos monocromáticos que contienen un punto, hay un triángulo heterocromático que también lo atrapa.

Una pregunta natural es: si se puede garantizar que hay un simplejo heterocromático que atrapa al punto, ¿cuál es la mínima cantidad de simplejos con esa propiedad que puedo garantizar? Para esto vamos a suponer que cada conjunto contiene

puntos y

está en el interior de las envolventes convexas (si no, considerando

copias de

, solo obtenemos un simplejo atrapando al punto, por lo que sin suponer algún tipo de posición general el problema no es interesante).

El teorema que mencioné muestra que , y la mejor cota superior que se conocía es

, por una construcción de Deza et al. [1], quienes conjeturaban que esta cota era óptima. Hace poco acaba de salir un manuscrito de Pauline Sarrabezolles, dando una respuesta afirmativa a la conjetura. Es decir,

.

La idea de la demostración se basa en una reducción del problema geométrico a uno combinatorio, estudiando lo que se llaman «configuraciones octaedrales». La idea de la reducción nace a partir de las siguientes dos observaciones

- Una versión fuerte del teorema de Carathéodory coloreado demuestra que solo es esencial que

de los colores contengan al origen [2]. Entonces, para cada vértice de la configuración de puntos, hay un simplejo heterocromático que usa ese vértice y contiene a

. Esto demuestra automáticamente que

, pero queremos más.

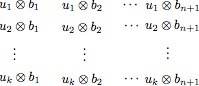

- Si consideramos

puntos de cada color, podemos representarlos como los vértices de un octaedro en

. Como los simplejos heterocromáticos representan la imagen de las caras de dicho octaedro (el cual es isomorfo a una esfera), cada punto en

está cubierto una cantidad par de veces por dichos simplejos.

Entonces uno puede definir una hipergráfica a partir del problema con un vértices por cada punto considerado en y una hiperarista (de tamaño

) por cada simplejo heterocromático que atrapa al punto que queremos. Entonces, tenemos una hipergráfica con

clases de vértices de tamaño al menos

cada uno de tal forma que

- Cada vértice está en al menos una arista

- Si consideramos dos vértices de cada clase, la hipergráfica inducida por ellos tiene una cantidad par de vértices.

La idea es probar que cada hipergráfica de este tipo tiene al menos aristas. Esto es lo que demuestra Sararabezolles, olvidándose de la primer condición y usando inducción sobre el mínimo número de aristas garantizadas si dicha condición sucede sólo para los vértices de

de las clases.

Les dejo el enlace al artículo de Sarrabezolles.

[1] Deza A., Huang S., Stephen T., and Terlaky T. (2006) Colourful simplicial depth. Discrete and Computational Geometry, 35, pp.597–604.

[2] Arocha, J. L., Bárány, I., Bracho, J., Fabila, R., & Montejano, L. (2009). Very colorful theorems. Discrete & Computational Geometry, 42(2), pp.142-154.

El teorema de Erdös-Ko-Rado

Si , cualquier familia

de

conjuntos que no contenga dos complementarios funciona (en la figura no hay

).

Hace poco estuve escribiendo sobre problemas donde la estructura local de intersección de familias de conjuntos tienen consecuencias globales en la familia en sí. Otro ejemplo muy bueno de esto es el teorema de Erdös-Ko-Rado, que habla de familias de conjuntos de tamaño fijo donde cada par de ellos se intersectan.

Lo sorprendente de este teorema es que hay una solución por Katona [1] basada en un conteo doble muy elegante, de tal manera que hace que el teorema parezca problema de olimpiada. Lo que dice el teorema es el siguiente

Teorema (Erdös, Ko, Rado 1961) – Sean un conjunto con

elementos y

una familia de subconjuntos de

de tamaño

. Si cada par de conjuntos en

se intersectan y

, entonces

.

Ver que hay familias con conjuntos es muy fácil. Basta considerar todos los conjuntos de

elementos que tengan a cierto elemento

fijo.

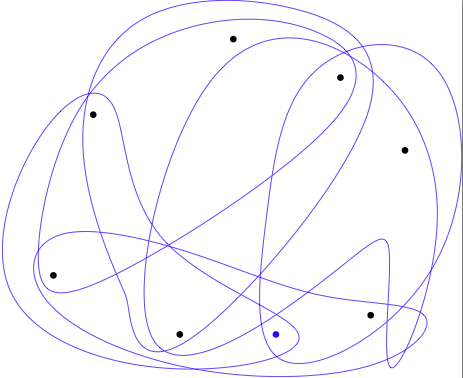

La idea de Katona consiste en ordenar los elementos de en un círculo y usar el siguiente lema.

Lema – Sea un conjunto de

elementos en un círculo. Si

es una familia de intervalos de

elementos seguidos, cada dos de ellos se intersectan y

entonces

.

Probar el lema no es difícil. Una manera de hacerlo es considerar un intervalo y dividir

en los intervalos que contienen al último elemento de

y los que no. Esto se puede usar para obtener la cota superior del número de intervalos. Otra manera de hacerlo (y más referencias) se pueden encontrar en [2].

Ya con esto, probar el teorema es bastante sencillo. Por cada manera de ordenar los conjuntos en un círculo, podemos contar cuántos conjuntos de quedan como elementos consecutivos. Por el lema sabemos que hay a lo más

. En el círculo hay

intervalos de

elementos consecutivos. Entonces, si por cada manera de ordenar

en un círculo nos fijamos en los conjuntos de

elementos que están como intervalos de

elementos consecutivos, cada conjunto de

elementos está siendo contado la misma cantidad de veces. Esto quiere decir que a lo más una proporción

de todos esos conjuntos están en

. Es decir,

.

Cabe destacar que si le imponemos más condiciones al tipo de intersecciones de los conjuntos, obtenemos condiciones mucho más fuertes sobre el tamaño de la familia. Por ejemplo, si hay un tal que cualesquiera dos conjuntos una familia

de subconjuntos (¡de cualquier tamaño!) de

tienen exactamente

elmentos en común, entonces

.

Lo bonito de estos teoremas es que, en general, las ideas con las que se resuelven son muy elegantes. La mejor exposición que he visto hasta ahora al respecto es por Frankl y Babai en un libro que (todavía) no sale publicado sobre métodos de álgebra lineal en problemas de combinatoria. Conseguirlo es una lata, pero es una joya que verdaderamente la pena.

[1] – Katona, G. O. H. (1972). A simple proof of the Erdös-Chao Ko-Rado theorem. Journal of Combinatorial Theory, Series B, 13(2), 183–184.

[2] – Brouwer, A. E., & Schrijver, A. (1979). Uniform hypergraphs. Packing and Covering in Combinatorics, Mathematical Centre Tracts, 106, 39–73.

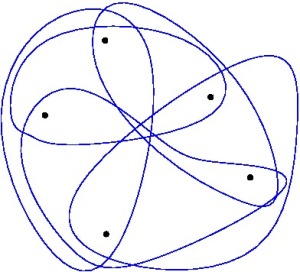

Una demostración del teorema de Tverberg

El teorema de Tverberg es uno de mis teoremas favoritos en geometría combinatoria. La idea detrás del teorema es que si uno tiene muchos puntos en , deberíamos poder partirlos en varios pedazos de tal forma que las envolventes convexas de cada uno tengan un punto en común. Este teorema dice exactamente qué tantos puntos son necesarios para esto.

Desde que Tverberg dio la primer demostración de este hecho en 1966, han aparecido otras más cortas y más elegantes a lo largo de los años, con una demostración espectacular por Sarkaria en 1992. La demostración de Sarkaria se ha difundido mucho, y encontrar textos o blogs muy buenos que la expliquen no es muy complicado (un buen ejemplo sería el blog de Gil Kalai). Sin embargo, como no he visto ninguna versión de esto en español, y últimamente he trabajado con problemas «tipo Tverberg», creo que vale la pena dedicarle una entrada. Lo que dice el teorema es lo siguiente:

Teorema (Tverberg 1966) – Dado un conjunto de

puntos en

, es posible encontrar una partición

de

en

pedazos de tal forma que

Donde significa la envolvente convexa de

.

El caso se conoce como el lema de Radon o el Teorema de Radon, y fue demostrado en 1921. Para este nada más se necesita álgebra lineal básica. Curiosamente lo que hace el argumento de Sarkaria es reducir la parte combinatoria del teorema a un problema métrico. Lo que se necesita para esto son dos ingredientes. El primero es el teorema de Carathéodory coloreado.

Teorema (Carathéodory coloreado) – Dadas familias de puntos

en

tales que cada una de ellas atrapa al origen, podemos encontrar puntos

de tal forma que el conjunto

también atrapa al origen.

Con decir que un conjunto atrapa al origen nos referimos a que

.

Este teorema es realmente métrico. Se le llama «coloreado» porque podemos pensar que cada familia está pintada de algún color, y lo que queremos es un simplejo heterocromático que atrapa al origen. Si esto no sucede, podemos considerar el simplejo heterocromático más cercano al origen y ver qué color le falta a su cara más cercana al

. Si todo funciona bien, demostrar que los puntos de ese color no atrapan al origen debería ser fácil.

El segundo ingrediente es el producto tensorial. Dados dos vectores ,

, el producto tensorial

es un vector en

tal que la entrada

-ésima es

. Lo único que nos interesa de este producto por el momento es que es una función bilineal de

.

Ahora sí, la idea brillante. La idea brillante es considerar vectores

en

que sean los vértices de un simplejo regular que atrapa al origen. Que sea regular realmente no es tan importante, pero facilita muchísimo las cuentas. Lo importante de estos vectores es que una combinación lineal de ellos satisface

si y solo si

.

Consideremos y

nuestros puntos en

. Podemos agregarles a todos una entrada

al final. Es decir, considerar los puntos

. Esto es un paso estándar para convertir problemas «afines» en problemas «lineales», abusando un poco del lenguaje. Ahora consideremos los puntos

con

. Estos son puntos que viven en

. Si los acomodamos como en la figura, notemos que cada columna atrapa al origen (porque los

lo hacían).

Entonces, por el teorema de Carathéodory coloreado, podemos elegir un elemento de cada columna de tal forma que el conjunto que obtenemos atrapa al origen. Es decir, para cada existe un

de tal forma que el conjunto

atrapa al origen. Los

van a definir nuestra partición, por lo que conviene considerar los conjuntos

tales que

Ahora sí, como atrapa al origen, tenemos que hay coeficientes no negativos

que suman

de tal forma que

Podemos usar la linealidad del producto tensorial para factorizar los , de tal forma que

(nota: si intentan escribir la ecuación de arriba expandiendo la primer suma, el compilador de de wordpress se niega a hacerlo, incluso si la parten en cachos).

La magia de la demostración es que la necesidad de que los coeficientes de una combinación de los que de

sean iguales se transfiere directamente en el producto tensorial. Es decir,

es el mismo punto para cada .

Viendo las primeras coordenadas, obtenemos que

es el mismo punto para cada

. Usando que la última coordenada es

, obtenemos que

tiene el mismo valor (positivo) para cada

, por lo que podemos suponer que es

.

Con esto obtenemos que los pedazos forman la partición que buscabamos.

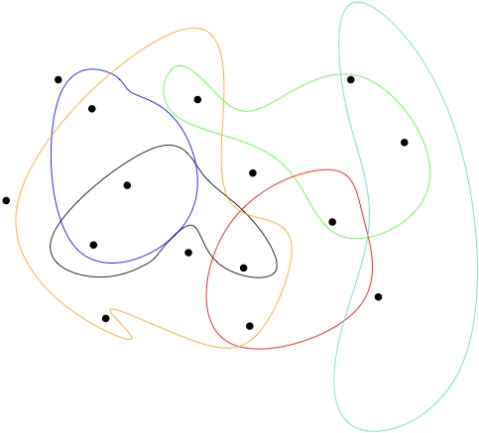

Helly para conjuntos finitos

Cuando empecé a escribir este blog mencioné el teorema de Helly, lo que dice es lo siguiente

Teorema 1 (Helly 1924): Sea una familia finita de conjuntos convexos en

. Si cada

de ellos tienen un punto en común, todos los conjuntos de

tienen un punto en común.

Si uno quita la condición de que los conjuntos sean convexos el teorema se vuelve claramente falso. La idea general detrás de este teorema es la siguiente.

Dada una familia de conjuntos que satisfacen cierta propiedad

, propiedades «locales» sobre sus intersecciones tienen consecuencias globales sobre sus intersecciones. El teorema de Helly es el ejemplo clásico, dónde

es «ser conjuntos convexos». Los teoremas de intersecciones de convexos no son el único lugar donde este tipo de teoremas aparece. Por ejemplo, si en vez de convexidad le pedimos a los conjuntos que ciertos grupos de homología sean triviales, el teorem se mantiene [1]. Si queremos relajar un poco la condición del teorema, ya no obtenemos una intersección de todos los conjuntos. Sin embargo, sigue siendo interesante (y usualmente muy difícil) poder demostrar que con pocos puntos podemos interesectar a toda la familia

.

Lo que quería presentar en esta entrada es una versión de este teorema pero fuera de un sentido geométrico. Así como en la condición que funciona para conjuntos finitos es que todos tengan la misma cantidad de elementos. El teorema es el siguiente:

Teorema 2 (Bollobás 1965): Sea una familia finita de conjuntos de tamaño

. Si para cada

de ellos existe un conjunto

de tamaño

que los intersecta a todos, entonces existe un conjunto de

de tamaño

que intersecta a todo

.

Para ver que el número es óptimo, basta considerar

como todos los subconjuntos de tamaño

de un conjunto de

elementos. No es posible intersectar todos con un conjunto de tamaño

, pero sí es posible hacerlo para cualesquiera

.

Si el teorema no fuera cierto, podemos ir quitando conjuntos de hasta que sin importar cuál conjunto quitemos, podamos encontrar dicho conjunto

. Supongamos que en este momento los elementos de

que quedan son

. Sabemos que al quitar cualquier

podermos encontrar un conjunto

de tamaño

que intersecta a todos los otros

. Como todo

no podía ser intersectada con un conjunto de tamaño

, tenemos que

y

son disjuntos. Además, sabemos que

. Con esto, basta demostrar lo siguiente:

Teorema 3 (Bollobás 1965). Sean conjuntos de tamaño

y

conjuntos de tamaño

tales que

si y solo si

. Entonces

.

La siguiente demostración es de Lovász y hace uso del álgebra exterior (cosa que es sorprendente si consideramos que el problema es completamente combinatorio).

Demostración: Sea la unión de todos los

y

. Sin pérdida de generalidad podemos considerar que

es un subconjunto de

de tal forma que cualesquiera

puntos de

son linealmente independientes. Dado

definimos

el producto exterior de sus elementos. Vamos a demostrar que

son linealmente independientes. Para eso consideremos una combinación lineal de ellos que dé

, es decir

Si consideramos el producto exterior con tenemos que

es el producto exterior de todos los elementos de

y

. Si

, hay al menos un elemento repetido en este producto exterior, por lo que da

. Esto implica que

. Como

es un conjunto linealmente independiente, el producto exterior de sus elementos no es

, por lo que

. Con esto tenemos que todos los coeficientes son

, por lo que los

son linealmente independientes.

Sin embargo, cada uno de ellos es el producto exterior de elementos de

, por lo que están en un espacio vectorial de dimensión

. Con esto, no puede haber más de $latex {{r+s}\choose{s}}$ de ellos, como se quería probar.

[1] Debrunner, H. (1970). Helly type theorems derived from basic singular homology. The American Mathematical Monthly, 77(4), 375–380.

Una demostración sencilla del teorema de Borsuk-Ulam

El teorema de Borsuk-Ulam es una herramienta topológica realmente padre por varias razones

- Es fácil de describir

- Tiene muchas equivalencias

- Tiene muchas demostraciones

- Tiene muchas aplicaciones dentro de otras áreas (como geometría discreta)

Conteos dobles y álgebra lineal.

Hace poco me encontré con un par de problemas que a primera vista parecen problemas de conteo doble, tipo olimpiada, pero resulta que salen con álgebra lineal. Me refiero a que parece tipo olimpiada porque hay problemas semejantes que han aparecido en estos concursos. Por ejemplo

Lista corta para la IMO 2004 C1: Hay 10001 estudiantes en una universidad. Los estudiantes se juntan en pandillas (un estudiante puede estar en varias pandillas) y las pandillas se juntan en sociedades (una pandilla puede estar en varias sociedades). Supón que hay sociedades y que se cumple lo siguiente:

- Cada pareja de estudiantes está en exactamente una pandilla.

- Por cada estudiante y cada sociedad, el estudiante pertenece a exactamente una pandilla de la sociedad

- Cada pandilla tiene una cantidad impar de estudiantes. Además, si una pandilla tiene

estudiantes (con

un entero no negativo), entonces está en exactamente

sociedades.

Encuentra todos los valores posibles de .

Solución.

Sea un estudiante fijo. Vamos a contar el número de parejas

tales que

es una sociedad y

es una pandilla tales que

pertenece a

y

pertenece a

. Por la segunda condición, por cada sociedad hay exactamente una de estas parejas, por lo que hay

parejas. Ahora vamos a contar por pandillas. Si en una pandilla

está

, debe haber otras

personas para alguna

entera no negativa. Entonces hay

parejas de la forma

. Como

estás en exactamente una pandilla con cada uno de los otros 10000 estudiantes, al variar

obtendremos exactamente

de estas parejas. Entonces el único valor posible de

es

. Además, si sólo hay una pandilla con los

estudiantes y

sociedades iguales (todas formadas por la única pandilla) es claro que todas las condiciones del problema se cumple. Entonces

funciona.

La idea en general es sencilla. Se nos da información sobre dos o tres conjuntos finitos donde uno representa subconjuntos de otro, y se nos dan algunas propiedades sobre la estructura de estos. Un conteo doble que logra usar de manera separada las propiedades nos da mucha información sobre el conjunto. Viendo este tipo de problemas, es natural intentar usar este tipo de herramientas en el siguiente problema.

Problema. En una ciudad con personas, la gente forma sociedades. Se sabe que cada sociedad tiene una cantidad impar de personas y cada par de sociedades tienen una cantidad par (posiblemente

) de personas en común. Demuestra que hay a lo más

sociedades.

La idea para resolver este problema (con la solución que conozco) sigue siendo un conteo doble, pero bastante más escondido.

Solución. Supongamos que hay sociedades. Consideremos una matriz

de

con entradas

ó

. la entrada

va a ser

ó

dependiendo si la persona

está o no (respectivamente) en la sociedad

. Podemos considerar la matriz como una cuyos elementos están en el campo

(para simplificar los argumentos a la hora de multiplicar. Ahora consideremos la matriz

. Es una matriz de

cuya entrada

nos dice la paridad de personas que están tanto en la sociedad

como en la sociedad

. Por lo tanto (dadas las condiciones del problema), es la matriz identidad. Con esto tenemos que su rango es

. Por otro lado, como es el producto de dos matrices de rango a lo más

(porque

es de

), su rango es a lo más

. Por lo tanto

, como queríamos.

Al final de cuentas esta solución sigue siendo un conteo doble, contando de dos maneras el rango de . Sin embargo, me parece que (a pesar de que la solución es muy elegante y corta) debería poder resolverse usando pura combinatoria básica. Realmente lo único que falta es una descripción combinatoria de qué significa realmente el rango de

, pero tampoco quiero una solución que parezca una traducción forzada. A veces en problemas de combinatoria las soluciones más elegantes son usando resultados de otras áreas, como la solución de Lovász de la conjetura de Kneser. Este es un resultado importante de combinatoria que se resuelve de manera muy impresionante con topología algebraica. Sin embargo, en este ejemplo no creo que tener que recurrir al álgebra lineal sea necesario.

El problema y la solución los conseguí del libro «thirty-three miniatures» de Jiří Matoušek. Ahí vienen muchas más aplicaciones bonitas (32 otras, como es de esperarse del título) de este tipo de herramientas a problemas en combinatoria.

Teoría de números y geometría

Cuando uno logra hacer una prueba interdisciplinaria en matemáticas suele tener un grado de elegancia bastante particular. Como hace rato que no hago una entrada voy a presentar una de mis pruebas favoritas.

Hoy quería presentar cómo se puede ver de manera exclusivamente geométrica que todo primo se puede escribir de a lo más una manera como suma de dos cuadrados.

Para probar esto, supongamos lo contrario. Es decir, tenemos un primo y vamos a probar que

y

son la misma pareja.

Entonces podemos trazar un cuadrilátero de tal manera que

Entonces por Pitágoras tenemos que

Entonces por Pitágoras tenemos que ,

son rectángulos. Con esto el cuadrilátero

es cíclico y está inscrito en un círculo con diámetro

.

Si le llamamos a la longitud del segmento

por Ptolomeo tenemos lo siguiente:

A partir de aquí hay dos maneras de proseguir, la más sencilla es usando una ley de cosenos en el triángulo , pero para uno de los pasos se necesita un manejo (mínimo) de congruencias, por lo que voy a seguir por el lado geométrico. En este caso también vamos a tratar de calcular

.

Primero denotemos ,

,

,

. Por los triángulos rectángulos conocemos todos los senos y cosenos de estos ángulos. Llamémosle

a la intersección de

y sean

,

,

.

Ahora sí, si aplicamos ley de senos a obtenemos que

De la misma manera obtenemos que . Con lo que tenemos

Además, por potencia desde tenemos que

. De aquí podemos se cancela una

y al despejar esta variable obtenemos que

Juntando esto y la ecuación anterior obtenemos que

Al juntarlo con la fórmula de ptolomeo y despejar nos queda

Con esto tenemos que alguno de y

es múltiplo de

(¡Ésto el lo único que vamos a usar de teoría de números!). Como podemos intercambiar en nuestro cuadrilátero original donde van

y

podemos suponer que el múltiplo es

y quedarnos con la construcción original. Entonces

. Pero como

era diámetro de nuestro círculo circunscrito obtenemos que

.

De aquí nuestro cuadrilátero es un rectángulo, por lo que y

, que es lo que queríamos.

Un problema de isometrías

Ahora quería presentar un problema bastante bonito, que habla sobre isometrías sin puntos fijos. Una isometría es una función que preserva distancia.

Problema: Dada isometría tal que para todo

se cumple que

entonces podemos encontrar una recta

tal que

.

Aquí estamos tomando a con su métrica usual. Un ejemplo clásico de isometría sin puntos fijos es una transalción. En este caso queda claro que cualquier recta con la misma dirección que la traslación queda fija.

Para probar este problema, primero vamos a ver qué pasa si encontramos un punto tal que

es mínimo.

Notemos que si son colineales, ya acabamos, porque mandaríamos la recta que pasa por

a la recta que pasa por

, que es la misma. Si no es la misma entonces consideremos

el punto medio de

. Este punto debe ir al punto medio de

.

Con esto, si le aplicamos la desigualdad del triángulo al que tiene vértices , como es un triángulo no degenerado obtenemos que

Esto contradice la minimalidad de

Esto contradice la minimalidad de por lo que hemos acabado.

Ver que el mínimo realmente existe es un poco técnico por lo que lo dejé al final. Resulta que toda isometría en

se puede ver de la forma

. Donde

es una matriz con ciertas propiedades y

es un vector. Con esto

. Usando esto se puede reducir el problema de encontrar un mínimo a encontrarlo en cierta esfera centrada en el origen, por lo que como estamos en un compacto eso existe.

El problema 5 de la IMO 2006

Hoy quería ver una solución a un problema de polinomios que apareció en una imo reciente, lo que dice es lo siguiente:

Problema: Sea un polinomio con coeficientes enteros y grado

. Sea

un entero positivo. Demuestra que hay a lo más

enteros

tales que

.

Nota: se refiere a

donde la

se aplicó

veces.

Cuando el problema es trivial, ya que los números que cumplen serían raíces del polinomio

, el cuál tiene grado

. Sin embargo, para

más grande hay que usar las condiciones extras, en este caso sólo tenemos lo de coeficientes enteros y que los números que buscamos son a su vez enteros.

La base para resolver este problema es la siguiente:

Sabemos que para todo

entero positivo. Con esto

. Con esto si

son enteros que cumplen la condición tenemos que (abusando un poco de la notación)

Con esto tenemos que todos los números en la lista tienen el mismo valor absoluto, en particular

Entonces y

están a la misma distancia, y lo único que puede cambiar es si están en el mismo orden o no. Es claro que si tenemos al menos 3 de estos números, los tres deben preservar su orden o los 3 se deben voltear (para preservar todas las distancias), por lo que usando un argumento inductivo, todos los números que cumplen esto preservan su orden o lo voltean.

Entonces hay un real r tal que o

para todo

entre los números que cumplen la condición.

Entonces todos los números que cumplen la condición son raíces de un polinomio de la forma o

. Como

tiene grado

ese polinomio también, por lo que hay a lo más

números que cumplan la condición, por lo que hemos acabado.

Para ver que la condición es necesaria$, si consideramos el polinomio

y cualquier

o $P(x) = -x + t$ (con cualquier

) y cualquier

par, todos los enteros cumplen lo que buscabamos.

Producto cruz y geometría euclidiana

El producto cruz es una función tal que produce un vector ortogonal a dos vectores dados, cuya norma es igual al doble del área del triángulo que forman esos dos vectores con el origen.

Es raro ver una aplicación de este tipo de herramientas en problemas de geometría moderna, sobre todo cuando tratan problemas en el plano, pero aquí va un ejemplo.

Problema : Sea un triángulo en el plano con ortocentro

y circuncentro

. Demuestra que hay dos de los triángulos

cuyas áreas suman la del tercero.

Solución con geometría moderna:

Como todos los triángulos tienen la misma base , sólo hay que demostrar que las longitudes de las alturas correspondientes cumplen lo que queremos. Sabemos que el segmento

pasa por el gravicentro

. Digamos que esta recta deja al vértice

de un lado y a

del otro. Si consideramos

el punto medio de

, entonces el segmento

intersecta a

en

. Eso quiere decir que la altura desde

es el doble que la de desde

, la cual es el promedio de las alturas desde

. Con esto hemos terminado.

Solución usando el producto cruz.

Si consideramos el origen en , tenemos que

. Imaginemos que el plano está encajado en

, por lo que ahora tiene sentido el producto cruz. Notemos que las áreas de los triángulos que queremos son la mitad de las normas de

y que estos últimos vectores son paralelos (por ser ortogonales al plano de

). Además como

obtenemos lo que queríamos.